Tại sao chúng ta cần định nghĩa trí tuệ? Trong phần trước về các mô hình nền tảng, chúng ta đã khám phá cách các hệ thống AI hiện đại ngày càng trở nên mạnh mẽ. Nhưng trước khi có thể thảo luận một cách có ý nghĩa về các rủi ro và tác động an toàn của các hệ thống này, chúng ta cần thống nhất về ý nghĩa của AGI khi đề cập đến nó. Một số người cho rằng "tia lửa" của AGI đã hiện diện trong các mô hình ngôn ngữ mới nhất (Bubeck et al., 2023), trong khi những người khác dự đoán AI đạt trình độ con người trong vòng một thập kỷ (Bengio et al., 2024). Nếu không có định nghĩa rõ ràng, làm sao chúng ta có thể đánh giá những tuyên bố này hoặc lập kế hoạch các biện pháp an toàn phù hợp?

Điểm cốt lõi là nếu bạn không thể định nghĩa một thứ gì đó, bạn không thể đo lường nó. Nếu không thể đo lường, bạn không thể theo dõi tiến trình một cách đáng tin cậy hoặc xác định các rủi ro tiềm ẩn. Hãy nghĩ đến một ví dụ trong vật lý - nói rằng "nó di chuyển 5" không có ý nghĩa nếu không chỉ định đơn vị đo lường. Nó di chuyển 5 mét, 5 feet hay 5 đơn vị cubit hoàng gia? Không ai biết. Nếu chúng ta không biết nó di chuyển bao xa hoặc nhanh như thế nào, thì chúng ta có thể áp dụng giới hạn tốc độ không? Câu trả lời cũng là không. Điều tương tự áp dụng cho trí tuệ, và các rủi ro cũng như kỹ thuật an toàn liên quan. Giống như vật lý cần các đơn vị đo lường tiêu chuẩn như mét và watt để vượt qua các mô tả định tính, nghiên cứu an toàn AI cần các định nghĩa nghiêm ngặt để vượt qua các so sánh mơ hồ và nhân cách hóa.

Điều gì khiến việc định nghĩa trí tuệ trở nên khó khăn? Nếu mọi người đều đồng ý rằng chúng ta cần một định nghĩa để đo lường tiến bộ và thiết kế các biện pháp an toàn, thì tại sao chúng ta lại không có một định nghĩa được chấp nhận rộng rãi? Vấn đề là từ "trí tuệ" là một thuật ngữ chúng ta sử dụng để mô tả nhiều khả năng chồng chéo nhau - từ giải quyết vấn đề và học tập đến thích nghi và suy luận trừu tượng. Ngoài ra, các ngành học thuật khác nhau nhìn nhận trí tuệ qua các góc độ khác nhau. Nhà tâm lý học nhấn mạnh vào các kỹ năng nhận thức có thể đo lường, nhà khoa học máy tính tập trung vào hiệu suất thực hiện nhiệm vụ, còn nhà triết học tranh luận về các đặc tính như mối quan hệ giữa trí tuệ với ý thức và nhận thức bản thân. Vậy phương pháp nào là phù hợp nhất để hiểu và lập kế hoạch cho an toàn AI?

Ví dụ: Phương pháp dựa trên sự bắt chước để đo lường trí tuệ. Bài kiểm tra Turing (hoặc trò chơi bắt chước) đề xuất rằng trí tuệ có thể được đo lường thông qua khả năng của máy móc trong việc bắt chước cuộc trò chuyện của con người (Turing, 1950). Tuy nhiên, cách tiếp cận hành vi này đã chứng minh là không đủ - các mô hình ngôn ngữ hiện đại thường có thể vượt qua các bài kiểm tra kiểu Turing mà không có năng lực suy luận cơ bản (Rapaport, 2020). Đây vẫn là một cách tiếp cận dựa trên quá trình, và chủ yếu được coi là một thí nghiệm tư duy triết học hơn là một thước đo cụ thể và có thể áp dụng được về trí tuệ.

Ví dụ: Các tiếp cận dựa trên ý thức về trí tuệ. Một quan điểm sớm tập trung vào các máy móc có thể thực sự hiểu và có các trạng thái nhận thức tương tự con người (Searle, 1980). Tuy nhiên, định nghĩa này gặp nhiều vấn đề. Thứ nhất, ý thức có thể là một trong những khái niệm khó định nghĩa hơn cả trí tuệ. Thứ hai, chúng ta không chắc chắn liệu trí tuệ và ý thức có liên quan mật thiết hay không - một hệ thống có thể rất thông minh mà không có ý thức, hoặc có ý thức mà không đặc biệt thông minh. AlphaGo rất thông minh trong bối cảnh chơi cờ vây, nhưng rõ ràng nó không có ý thức. Một hệ thống không cần phải có ý thức để gây hại. Việc một hệ thống AI có ý thức hay không không ảnh hưởng đến khả năng đưa ra quyết định có tầm ảnh hưởng lớn hoặc thực hiện các hành động tiềm ẩn nguy hiểm.

Ví dụ: Các tiếp cận dựa trên quá trình/khả năng thích ứng đối với trí tuệ. Quan điểm dựa trên quá trình xem trí tuệ là hiệu quả của việc học tập và thích ứng, chứ không phải là năng lực tích lũy. Một số nhà nghiên cứu ủng hộ quan điểm này. Theo quan điểm này, trí tuệ là "khả năng của một hệ thống thích ứng với môi trường trong khi hoạt động với kiến thức và tài nguyên hạn chế" (Wang, 2020). Hoặc nó được mô tả là "hiệu quả mà một hệ thống có thể chuyển đổi kinh nghiệm và kiến thức trước đó thành kỹ năng" (Chollet, 2019). Mặc dù sự tập trung vào học tập meta và thích ứng nắm bắt được điều gì đó cơ bản về trí tuệ, nhưng từ góc độ an toàn, điều quan trọng cuối cùng là những gì các hệ thống này có thể thực sự làm - năng lực cụ thể của chúng - chứ không phải cách chúng đạt được những năng lực đó. Điều này dẫn chúng ta đến phương pháp cuối cùng.

Ví dụ minh họa: Phương pháp tiếp cận dựa trên năng lực đối với trí tuệ. Câu hỏi động lực đằng sau quan điểm này là - Nếu một hệ thống AI có thể đạt được hiệu suất nguy hiểm ở mức độ con người hoặc cao hơn, liệu có thực sự quan trọng việc nó đạt được điều này thông qua các quá trình học tập phức tạp, ghi nhớ hiệu quả, có hoặc không có ý thức? Nếu một hệ thống AI có năng lực có thể gây ra rủi ro - như lập kế hoạch phức tạp, thao túng hoặc lừa dối - thì những rủi ro này tồn tại bất kể hệ thống đạt được những năng lực này thông qua "trí tuệ thực sự", "hiểu biết thực sự" hay so sánh mẫu phức tạp. Phương pháp dựa trên năng lực vượt qua các tranh luận triết học bằng cách đặt ra những câu hỏi cụ thể: Hệ thống thực sự có thể làm gì? Nó có thể làm điều đó tốt đến mức nào? Nó có thể xử lý phạm vi nhiệm vụ nào? Khung này cung cấp các tiêu chuẩn rõ ràng cho sự tiến bộ và, đặc biệt quan trọng đối với công tác an toàn, các cách rõ ràng để xác định các rủi ro tiềm ẩn. Hầu hết các phòng thí nghiệm AI sử dụng tiếp cận tập trung vào năng lực này trong cách họ định hình mục tiêu AGI của mình. Ví dụ, AGI đã được định nghĩa là "các hệ thống tự chủ cao vượt trội con người trong hầu hết các công việc có giá trị kinh tế" (OpenAI, 2014). Các cân nhắc về an toàn cũng được định hình tương tự, với mục tiêu là đảm bảo "AI chuyển đổi giúp con người và xã hội" (Anthropic, 2024).

Xét đến những yếu tố này, trong phần lớn nội dung cẩm nang này, trọng tâm chính của chúng ta sẽ vẫn là khung khổ thực tiễn về năng lực để đánh giá và đánh giá an toàn. Phương pháp tiếp cận tập trung vào năng lực này là phù hợp nhất cho công tác an toàn ngay lập tức, quy định và quyết định triển khai. Chúng tôi thừa nhận rằng nghiên cứu về ý thức, tri giác, đạo đức liên quan đến trí tuệ số và bản chất cơ bản của trí tuệ vẫn có giá trị nhưng ít khả thi cho công tác an toàn ngay lập tức.

Trong phần tiếp theo, chúng ta sẽ khám phá cách định nghĩa và đo lường năng lực một cách cụ thể trong khung này. Chúng ta sẽ thấy rằng việc vượt qua các ngưỡng nhị phân đơn giản giữa "trí tuệ nhân tạo hẹp" và "trí tuệ nhân tạo tổng quát" giúp chúng ta hiểu rõ hơn về sự phát triển của năng lực trí tuệ nhân tạo và các rủi ro liên quan.

Tại sao các định nghĩa truyền thống về AGI lại chưa đủ? Trong phần trước, chúng ta đã tìm hiểu cách các mô hình nền tảng đang trở nên ngày càng mạnh mẽ và đa năng. Tuy nhiên, trước khi có thể thảo luận một cách có ý nghĩa về các rủi ro và tác động an toàn, hoặc đưa ra dự đoán về tiến bộ trong tương lai, chúng ta cần có các phương pháp rõ ràng để đo lường và theo dõi năng lực của AI. Phần này giới thiệu các khung khổ để đo lường tiến bộ hướng tới trí tuệ nhân tạo tổng quát (AGI) và hiểu mối quan hệ giữa năng lực, tự định hướng và rủi ro. Ví dụ, định nghĩa của OpenAI về AGI là "các hệ thống vượt trội con người trong hầu hết các công việc có giá trị kinh tế" (OpenAI, 2014), hoặc định nghĩa phổ biến "Trí tuệ đo lường khả năng của một tác nhân đạt được mục tiêu trong một loạt môi trường đa dạng." (Legg & Hutter, 2007) và nhiều định nghĩa khác không đủ cụ thể để có thể áp dụng thực tế. Con người nào? Mục tiêu nào? Nhiệm vụ nào có giá trị kinh tế? Còn các hệ thống vượt trội hiệu suất con người trong một số nhiệm vụ nhưng chỉ trong thời gian ngắn thì sao?

Tại sao chúng ta cần khung đo lường tốt hơn? Trong lịch sử, các cuộc thảo luận về AGI thường dựa vào các ngưỡng nhị phân - các hệ thống được phân loại là "hẹp" hoặc "chung", "yếu" hoặc "mạnh", "dưới mức con người" hoặc "mức con người". Mặc dù những phân biệt này đã giúp định hình các cuộc thảo luận ban đầu về AI, chúng trở nên ngày càng không đủ khi các hệ thống AI trở nên phức tạp hơn. Giống như chúng ta đã tránh các tranh luận về việc liệu AI có thể thể hiện "trí tuệ thực sự" hay "hiểu biết thực sự" để tập trung vào một khung khổ thực tiễn hơn dựa trên năng lực, tương tự, chúng ta muốn tránh các tranh luận về việc liệu một hệ thống AI có "đạt mức độ con người" hay không. Việc có thể đưa ra các tuyên bố như - nó vượt trội hơn 75% người trưởng thành có kỹ năng trên 30% nhiệm vụ nhận thức - sẽ chính xác hơn nhiều.

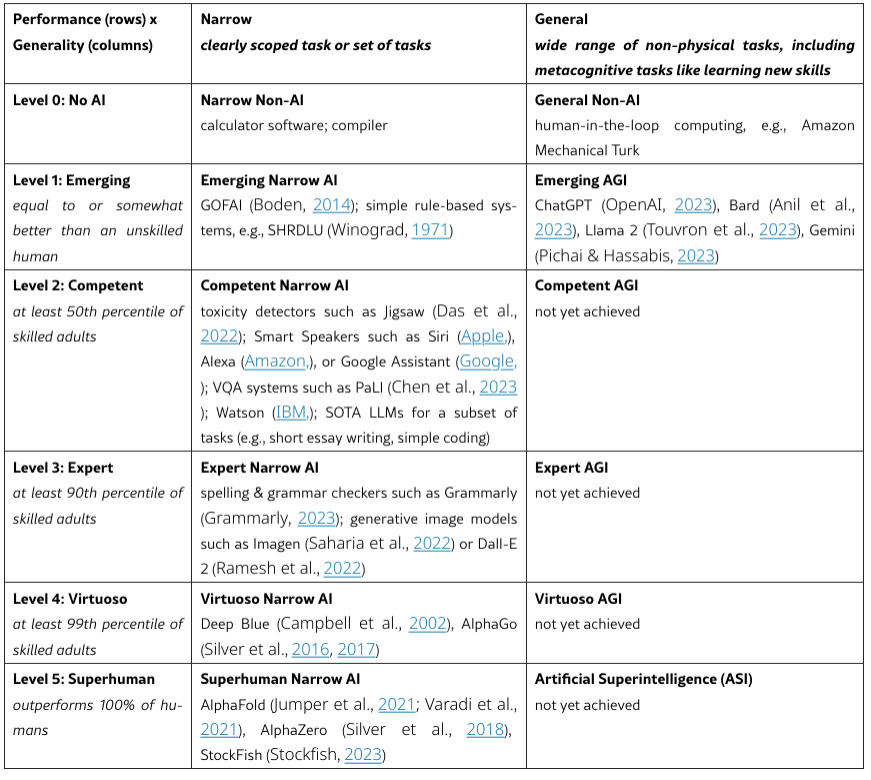

Đây là cái nhìn liên tục về việc đo lường hiệu suất của AI. Tất cả các điểm trên trục này có thể được gọi là trí tuệ nhân tạo hẹp (ANI) (trừ điểm gốc).

Trí tuệ nhân tạo hẹp (ANI) (IBM, 2023)

Trí tuệ nhân tạo yếu (Weak AI) — còn được gọi là Trí tuệ nhân tạo hẹp (Narrow AI) hoặc Trí tuệ nhân tạo hẹp (ANI) — là loại trí tuệ nhân tạo được đào tạo và tập trung để thực hiện các tác vụ cụ thể. Trí tuệ nhân tạo yếu là nền tảng cho hầu hết các ứng dụng trí tuệ nhân tạo xung quanh chúng ta ngày nay. Thuật ngữ "hẹp" có thể là mô tả chính xác hơn cho loại trí tuệ nhân tạo này, vì nó không hề yếu; nó cho phép các ứng dụng rất mạnh mẽ, như Siri của Apple, Alexa của Amazon, IBM Watson và xe tự lái.

Các cấp độ của trí tuệ nhân tạo hẹp (ANI). Chúng ta nên xem xét hiệu suất của các hệ thống AI trên một phổ liên tục. Các định nghĩa truyền thống về ANI tương ứng với hiệu suất cao trên một tỷ lệ rất nhỏ các tác vụ. Ví dụ, các động cơ cờ vua như AlphaZero vượt trội hơn 100% con người, nhưng chỉ trên một số tác vụ nhận thức. Tương tự, các hệ thống nhận diện hình ảnh chuyên biệt có thể vượt trội hơn 95% con người, nhưng lại chỉ trên một phần rất nhỏ các tác vụ có thể. Theo định nghĩa trên, tất cả các hệ thống này đều được coi là ANI, nhưng nếu chúng ta xem xét chúng trên một phạm vi liên tục về tỷ lệ phần trăm con người có kỹ năng mà chúng có thể vượt trội, chúng ta sẽ có một bức tranh cụ thể và chi tiết hơn.

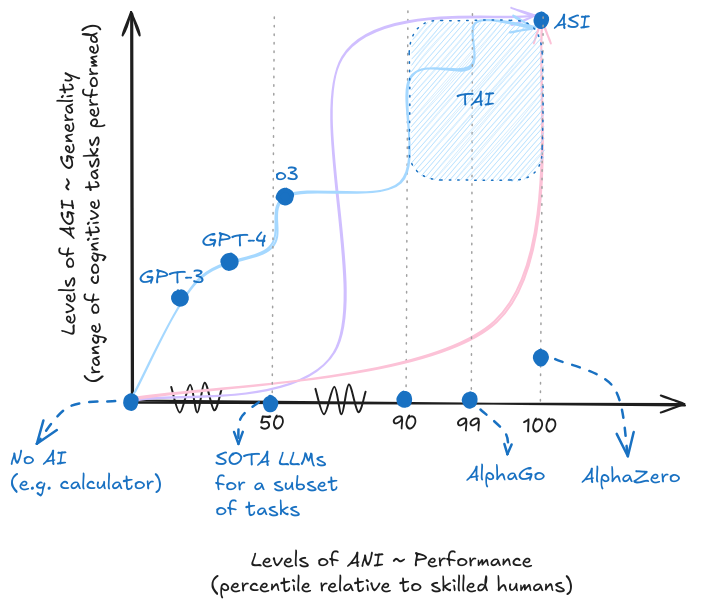

Làm thế nào để xây dựng một khung đo lường tốt hơn cho AGI? Chúng ta cần theo dõi tiến bộ của AI trên cả hai khía cạnh: hiệu suất (nó có thể thực hiện các tác vụ tốt đến mức nào?) và tính tổng quát (nó có thể thực hiện bao nhiêu tác vụ khác nhau?). Giống như chúng ta có thể mô tả một điểm trên bản đồ bằng vĩ độ và kinh độ, chúng ta có thể đặc trưng hóa các hệ thống AGI bằng mức độ tổ hợp giữa hiệu suất và độ phổ quát, được đo lường bằng bài kiểm tra và đánh giá. Khung này cung cấp cho chúng ta một cách theo dõi tiến bộ chi tiết hơn. Độ chính xác này giúp chúng ta hiểu rõ hơn cả năng lực hiện tại và các hướng phát triển có thể xảy ra.

Hệ thống AI hiện tại nằm ở đâu trong khung này? Các mô hình ngôn ngữ lớn như GPT-4 cho thấy một mô hình thú vị - chúng vượt trội hơn khoảng 50% người trưởng thành có kỹ năng trên khoảng 15-20% tác vụ nhận thức (như viết cơ bản và lập trình), trong khi ngang bằng hoặc vượt qua hiệu suất của con người không có kỹ năng trên một phạm vi rộng hơn các tác vụ. Điều này cung cấp cho chúng ta một cách chính xác hơn để theo dõi tiến bộ so với việc tranh luận liệu các hệ thống này có đủ điều kiện để được gọi là "AGI" hay không. Các mô hình ngôn ngữ lớn như GPT-4 là các dạng sơ khai của AGI (Bubeck, 2023), và theo thời gian, chúng ta sẽ đạt được AGI mạnh mẽ hơn khi cả tính tổng quát và hiệu suất đều tăng lên. Để hiểu cách khung liên tục này liên quan đến các định nghĩa truyền thống, hãy xem xét cách các khái niệm lịch sử chính được ánh xạ vào không gian hiệu suất-tổng quát của chúng ta.

Trí tuệ nhân tạo biến đổi (TAI) (Karnofsky, 2016)

Trí tuệ nhân tạo tiềm năng trong tương lai có thể gây ra một sự chuyển đổi tương đương hoặc thậm chí quan trọng hơn so với Cách mạng Nông nghiệp hoặc Cách mạng Công nghiệp.

Mặc dù tất cả các định nghĩa này đều đề cập đến một thang đo liên tục về năng lực và tính tổng quát, có một khía cạnh thường được thảo luận mà các phương pháp đo lường năng lực này không tính đến. Đó là khái niệm về thời gian và hiệu quả.

(t,n)-AGI (Ngo, 2023)

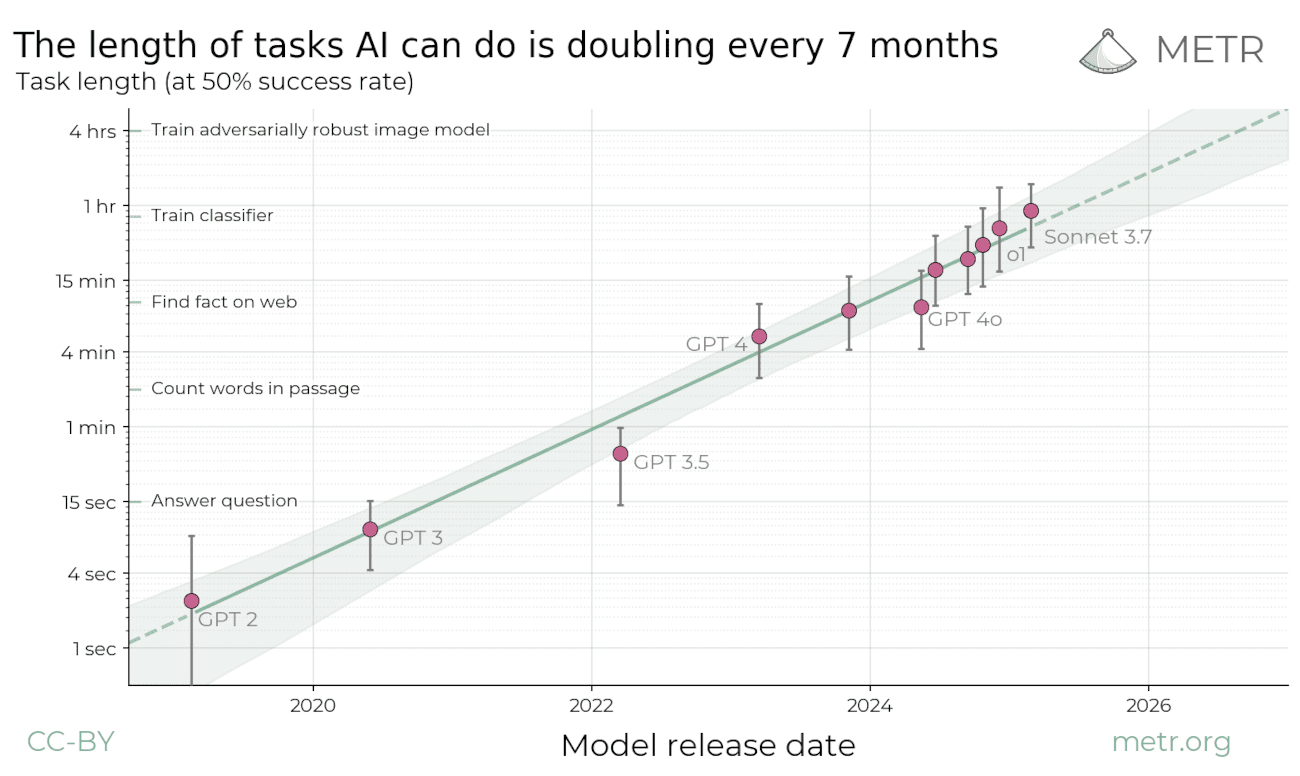

Cho một khung thời gian ‘t’ để hoàn thành một tác vụ nhận thức, nếu hệ thống AI có thể vượt trội hơn một chuyên gia con người cũng được giao khung thời gian ‘t’ để thực hiện cùng tác vụ, thì hệ thống AI đó được gọi là t-AGI cho khung thời gian ‘t’ đó. Nếu một hệ thống có thể vượt trội hơn ‘n’ chuyên gia con người đang thực hiện nhiệm vụ trong khoảng thời gian ‘t’, thì chúng ta gọi nó là (t,n)-AGI cho khoảng thời gian cụ thể ‘t’ và số lượng chuyên gia ‘n’.

Ví dụ, nếu một hệ thống AI vượt qua năng lực của một chuyên gia con người trong một giây trên một tác vụ nhận thức cụ thể, nó sẽ được phân loại là "AGI một giây". Thước đo có thể mở rộng này áp dụng cho các khoảng thời gian dài hơn, như một phút, một giờ hoặc thậm chí một năm, tùy thuộc vào hiệu quả của AI so với chuyên môn con người trong các khoảng thời gian đó. Chúng ta có thể lập luận rằng chúng ta đã có thứ gì đó trong khoảng từ AGI một phút đến AGI một giờ. AI có thể vượt qua con người trong việc nhận diện đối tượng trong hình ảnh, hiểu biết cơ bản về vật lý, giải quyết các bài toán/bài thi cực kỳ phức tạp, viết bài báo ngắn hoặc bài đăng blog, thực hiện hầu hết các nhiệm vụ trong công việc văn phòng (ví dụ: chẩn đoán bệnh nhân, đưa ra ý kiến pháp lý). AGI một năm sẽ vượt qua con người trong hầu hết mọi thứ. Chủ yếu vì hầu hết các dự án có thể được chia thành các nhiệm vụ con có thể hoàn thành trong khoảng thời gian ngắn hơn.

Trong khung này, một siêu trí tuệ (ASI) có thể tương tự như một AGI (một năm, tám tỷ), tức là ASI có thể được xem như một AGI vượt trội so với tám tỷ con người phối hợp trong một năm để hoàn thành một nhiệm vụ cụ thể (Ngo, 2023).

Khung (t,n)-AGI không tính đến số lượng bản sao của AI chạy đồng thời. Cũng có câu hỏi mở về những tác vụ nhận thức/đánh giá/bài kiểm tra cụ thể nào chúng ta sẽ sử dụng để đo lường năng lực trừu tượng? Một trong những tác vụ được đo lường phổ biến nhất là năng lực của AI trong việc nghiên cứu AI (và các tập con của năng lực đó như lập trình).

Trí tuệ nhân tạo biến đổi (TAI). Trí tuệ nhân tạo biến đổi là một điểm đặc biệt thú vị trong khung t-n-AGI của chúng ta vì nó không bị ràng buộc bởi các ngưỡng hiệu suất hoặc tính tổng quát cụ thể. Thay vào đó, nó tập trung vào phạm vi tầm ảnh hưởng. Ví dụ, một hệ thống có thể được coi là biến đổi bằng cách đạt được hiệu suất trung bình (vượt qua 60% con người) trên một phạm vi rộng các tác vụ kinh tế quan trọng (50% các tác vụ nhận thức), hoặc bằng cách đạt được hiệu suất xuất sắc (vượt qua 99% con người) trên một tập hợp nhỏ nhưng quan trọng các tác vụ (20% các tác vụ nhận thức) như nghiên cứu và phát triển tự động.

Trí tuệ nhân tạo ở mức độ con người (HLAI). Thuật ngữ này đôi khi được sử dụng thay thế cho AGI, và đề cập đến một hệ thống AI có trí tuệ ngang bằng con người trong hầu hết các công việc có giá trị kinh tế. Tuy nhiên, chúng tôi chỉ giải thích nó ở đây vì lý do hoàn chỉnh. Khái niệm "trình độ con người" không được định nghĩa rõ ràng, điều này khiến việc áp dụng định nghĩa này trở nên khó khăn. Nếu chúng ta áp dụng khái niệm này vào khung trình độ AGI, thì nó tương ứng với việc vượt trội hơn 99% người trưởng thành có kỹ năng trong hầu hết các tác vụ nhận thức không liên quan đến thể chất.

Siêu trí tuệ nhân tạo (ASI) (Bostrom, 2014)

Bất kỳ trí tuệ nào vượt trội đáng kể so với hiệu suất nhận thức của con người trong hầu hết các lĩnh vực quan tâm.

Trí tuệ nhân tạo siêu việt (ASI). Nếu các hệ thống đạt được hiệu suất vượt trội so với con người trong tất cả các tác vụ nhận thức, thì đây sẽ là hình thức mạnh mẽ nhất của AGI, còn được gọi là siêu trí tuệ. Trong khung khổ của chúng tôi, ASI đại diện cho góc trên bên phải - các hệ thống vượt trội 100% con người trên gần 100% các tác vụ nhận thức.

Mối quan hệ giữa các cấp độ AGI và rủi ro là gì? Hiểu các hệ thống AI thông qua các chỉ số hiệu suất liên tục và tính tổng quát giúp chúng ta đánh giá rủi ro tốt hơn. Thay vì chờ đợi các hệ thống vượt qua một "ngưỡng AGI", chúng ta có thể xác định các tổ hợp cụ thể giữa hiệu suất và tính tổng quát đòi hỏi các biện pháp an toàn tăng cường. Ví dụ: